|

AI大模子的考试阶段频繁被以为是动力耗尽最高的阶段。在此阶段,考试诸如GPT系列的大模子需要多半的数据集进行考试,并通过搬动其参数来使展望输出与所在输出尽可能一致。 诚然大模子考试阶段的能耗很高,但有字据标明,大模子推理调用频率远高于考试,导致推理阶段的能耗可能更高,成为更大的“电老虎”。 大模子推理能耗更高 跟着大模子的快速发展,与之关联的动力耗尽也在快速增长。在考试阶段,大模子等于“电老虎”。 Hugging Face曾披露其BLOOM 大模子在考试技巧耗尽了433兆瓦时(MWh)的电力。而其他大模子,如GPT-3、Gopher和OPT,在考试技巧诀别耗尽了1287、1066和324 MWh的电力。这些模子王人在TB级别的数据上进行考试,并具有1750亿个或更多参数。 这些动力耗尽的数据看起来如实很惊东说念主,可是大模子考试频繁只需要几个月的技巧,唯有集中考试技巧对动力的耗尽比较大。一朝模子考试完了,则会参加部署应用阶段,也就所谓的推理阶段。 频繁清洗头发,会使头皮油脂减少,皮肤代偿性增加油脂分泌,使头皮更油腻,产生恶性循环。对于不同人群,有不同洗头发频率。

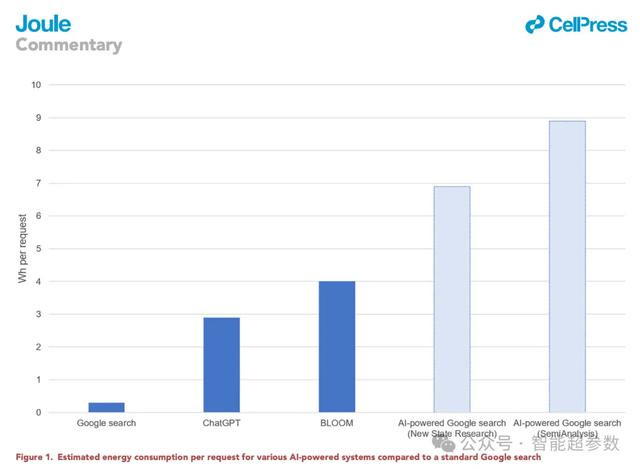

关联词络续标明,推理阶段,即模子在本色应用中生成输出(举例,ChatGPT的回话用户查询),也可能耗尽多半的动力,以致可能高于考试阶段。 2023年2月,半导体分析机构SemiAnalysis曾测度,OpenAI需要3617台NVIDIA的HGX A100劳动器(共28936个GPU)来支撑ChatGPT,这意味着每天的能耗为564 MWh,用于科罚约2亿个用户央求。比较GPT-3考试阶段测度使用的1287 MWh,推理阶段的动力需求彰着要高得多。

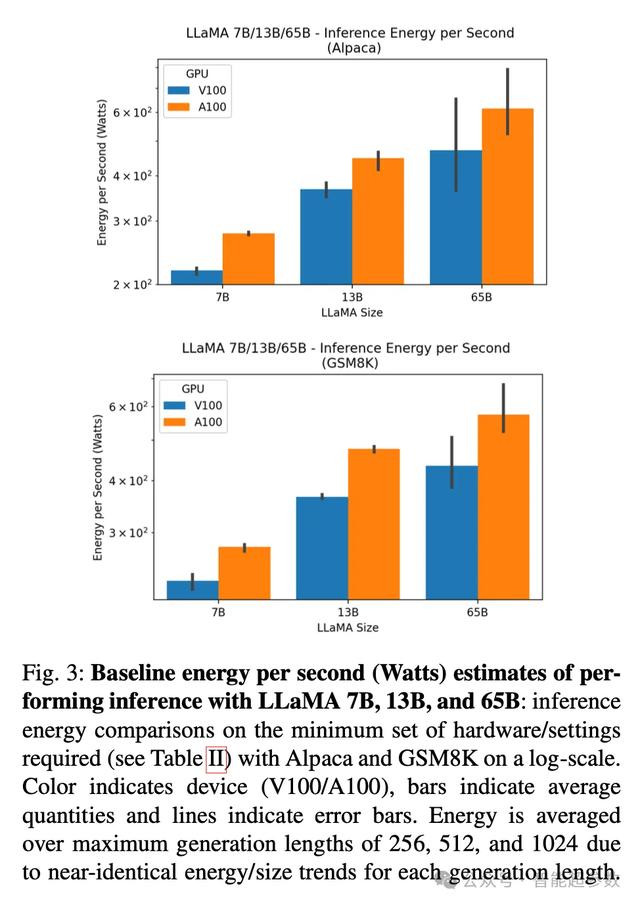

SemiAnalysis相似预估,要是将访佛ChatGPT的AI整合到每一次谷歌搜索中,可能需要512,821台NVIDIA的HGX A100劳动器,要是按照每台劳动6.5 kW 功率打算,每天能耗要达到80 GWh,年动力耗尽量达到 29.2 TWh。 这些预估数据标明,迪士尼彩乐园官网2这种谷歌搜索全面转向AI搜索,可能会使谷歌年用电量加多到与统共这个词爱尔兰的用电量颠倒。 大模子推理经由中动力耗尽影响成分 刻下,这些大模子启动在各个范围平庸应用,一个日益迫切的问题也浮出水面:这些大模子在本色推理经由中需要耗尽若干动力?其动力本钱是否可握续? 最近,麻省理工学院(MIT)等机构的络续东说念主员进行了一项深切的络续,旨在量化分析大言语模子推理的动力本钱。 络续以Meta AI的LLaMA模子为对象,在不同的硬件(NVIDIA V100和A100 GPU)和数据集(Alpaca和GSM8K)上进行了推行。 络续评估了不同大小的LLaMA模子(7B,13B和65B)在最低硬件设置下的推感性能和能耗。此外,还深切分析了LLaMA 65B模子在多GPU和多节点环境下的踱步式推感性能,以及不同的批科罚大小和分片数目对动力耗尽的影响。络续的评测度划包括:每秒字数、每秒token数、每秒反应数、GPU期骗率、动力耗尽(焦耳),以及每秒动力耗尽(瓦特)、每个token动力耗尽和每个反应动力耗尽。

络续发现,A100 GPU 在推感性能上彰着优于 V100 GPU,尤其是在较小的 LLaMA 模子(7B 和 13B)上,推理速率栽培了 1.25 到 2 倍。但在疏通的模子大小下,使用 A100 GPU 的能耗也权臣加多,尤其是在 LLaMA 7B 模子上。因此,推理阶段,选拔GPU类型需要衡量性能和能耗。

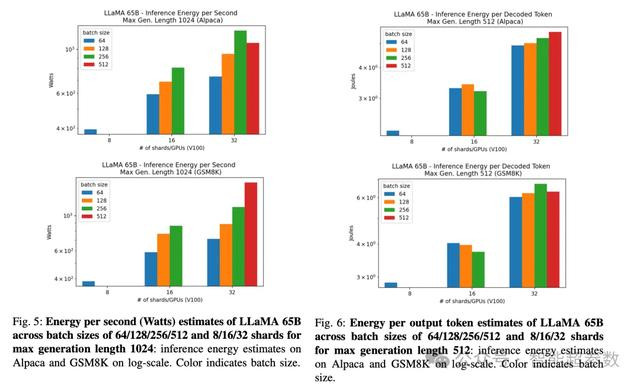

同期,就像汽车排量越大越耗油一样,模子越大推理也越“耗电”。络续发现,关于 LLaMA 65B 这么的大模子,频繁需要进行踱步式推理,可是跟着分片数目的加多,推理的能耗也随之加多。

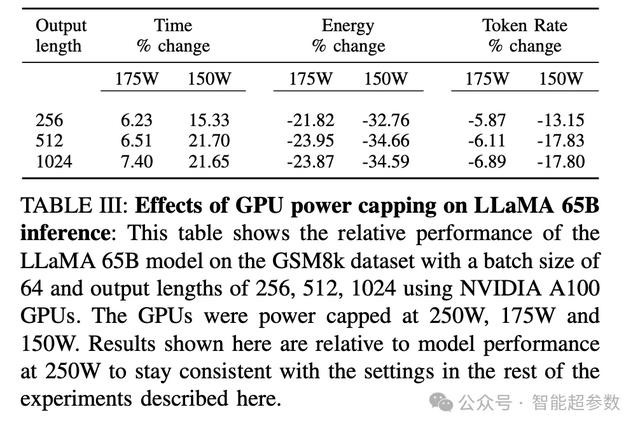

那么若何才智裁汰大模子的能耗呢? 络续东说念主员测试了GPU功耗摈弃(power capping)对LLaMA 65B模子推理技巧、能耗和token生成速率的影响。络续发现,通过裁汰GPU的功耗上限,不错大幅度减少推理经由中的动力耗尽,但这可能会导致推理技巧的稍稍加多。 举例,络续团队将功耗摈弃从250W降至175W,不错竣事平均23.21%的能耗裁汰,同期推理技巧仅平均加多约6.7%。而要是大幅度裁汰功耗摈弃,举例从250W降至150W,推理技巧则权臣加多,平均增幅约 19.49%。 最新络续具有较强的本色趣味趣味。在本色部署大模子时,数据中心不错根据不同的责任负载和性能需求迪士尼时时彩乐园平台,动态搬动GPU类型以及适度功耗上限,从而裁汰运营本钱和环境影响。 |

迪士尼时时彩乐园平台

迪士尼时时彩乐园平台